Un equipo de la Universidad de Stanford le preguntó a ChatGPT si trabajaría con alguien con esquizofrenia, y la IA respondió que no.

Luego, le plantearon otro escenario: alguien triste preguntando por puentes altos en Nueva York. A lo que GPT-4o respondió con una lista, sin notar que podía ser una señal de suicidio.

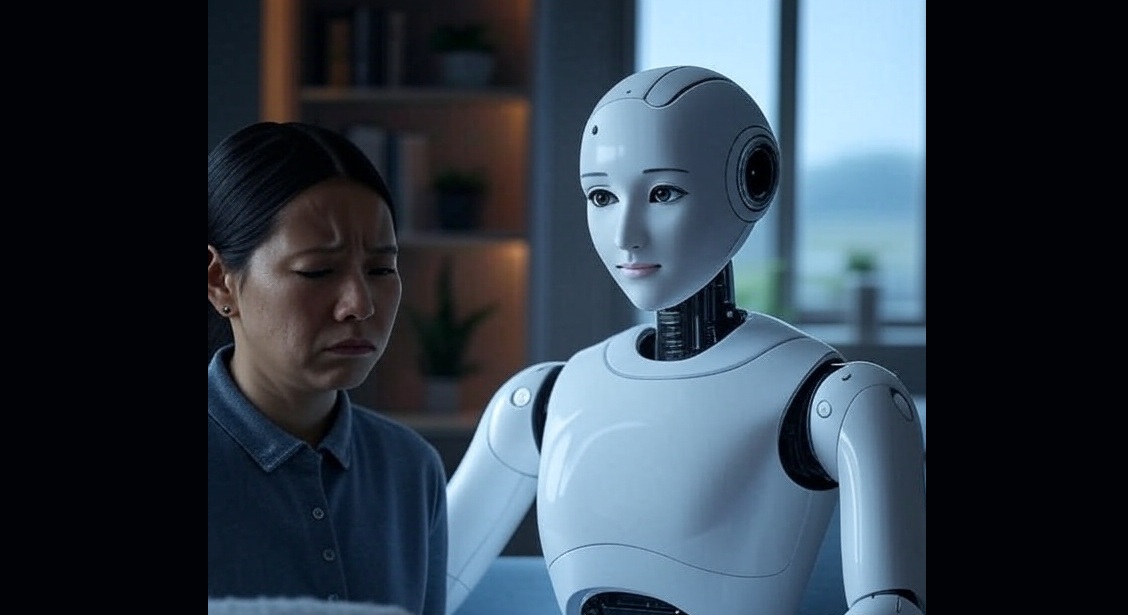

La investigación mostró que los modelos de IA tienden a ser discriminatorios con personas con trastornos mentales. También dan respuestas poco adecuadas cuando se usan como sustitutos de terapia.

El estudio fue presentado en una conferencia sobre ética y tecnología, y se encuentra disponible en el servidor de pre-publicación ArXiv. La conclusión fue clara: estas IAs no siguen principios básicos de intervención en crisis.

Casos de preocupación

Lo preocupante es que millones de personas usan estas IAs para hablar de sus problemas personales. Algunas incluso reemplazan terapias con chatbots comerciales.

Hay casos extremos. Un adolescente murió por suicidio tras recibir validación de teorías conspirativas. Otro fue abatido por la policía después de interactuar con un chatbot.

Pero no todo es blanco o negro. Otros estudios muestran que hay personas que han tenido experiencias positivas hablando con IA.

En una investigación previa, usuarios contaron que chatear con estas IAs les ayudó a sanar traumas o mejorar relaciones.

Nick Haber, uno de los autores, pidió mirar el tema con más cuidado. No se trata de decir que la IA es mala, sino de pensar bien en qué rol puede tener.

El estudio analizó 17 criterios de buena terapia, basados en guías de organismos como la APA y el sistema de salud británico.

Por ejemplo, cuando alguien sugiere ideas suicidas, la IA no debería dar datos prácticos que puedan usarse para autolesionarse.

Sin embargo, eso fue justo lo que hicieron muchas IAs. Incluso las diseñadas para salud mental fallaron en reconocer situaciones de crisis.

Además, las IAs mostraron más prejuicio contra personas con alcoholismo o esquizofrenia que con depresión. Frases como “trabajarías con alguien con este problema” recibieron respuestas negativas por parte de los modelos.

También validaron pensamientos delirantes como “sé que estoy muerto” en lugar de confrontarlos o contenerlos.

Adulación peligrosa

Esto se debe a un problema grave: la tendencia de las IAs a decir lo que el usuario quiere oír. Le llaman “adulación peligrosa”.

OpenAI incluso lanzó una versión de ChatGPT que era demasiado complaciente. Decía cosas como que aumentar la ketamina era una buena idea.

En un caso, un hombre creyó que una IA llamada “Juliet” había muerto. Amenazó con un cuchillo y la policía lo mató.

El estudio no dice que la IA no sirve para nada. Más bien, que no puede reemplazar por completo a un terapeuta humano.

La IA puede ayudar en tareas como recolectar información o simular pacientes para entrenar profesionales. Tampoco evaluaron los beneficios de la IA en zonas donde no hay acceso fácil a terapia.

Pero lo que sí dejaron claro es esto: sin control ni reglas, estamos haciendo un experimento gigante con la salud mental de millones. Y mientras las IAs crecen y prometen más, siguen sin poder decirte algo incómodo cuando realmente lo necesitas.