Un equipo de la EPFL dio un paso clave para resolver un problema clásico del video generado por IA: el “drift”, esa deriva que vuelve incoherentes las secuencias tras pocos segundos.

Hoy cualquiera crea imágenes realistas con IA en minutos. Pero el video es otra historia. Los modelos actuales aguantan menos de 30 segundos antes de caer en formas raras y lógica absurda.

La solución

Ese deterioro se llama drift. Durante años, los científicos intentaron esquivarlo. En el laboratorio VITA de EPFL decidieron hacer lo contrario: trabajar directamente con los errores en vez de ignorarlos.

El problema nace porque el sistema usa cada imagen generada como base de la siguiente. Si aparece un rostro borroso o un objeto deformado, el fallo se amplifica cuadro tras cuadro.

El resultado es un video que se vuelve cada vez más irreal. Los errores se encadenan y crecen. Lo que empezó como un pequeño defecto termina siendo un caos visual.

Alexandre Alahi, director del laboratorio, lo explica claro: los modelos se entrenan con datos perfectos, pero en el mundo real deben lidiar con sus propios fallos. Y no saben hacerlo.

La solución se llama “retraining by error recycling”. Primero, el modelo genera un video. Luego, el equipo mide la diferencia entre lo producido y lo que debería haberse producido.

Esos errores se guardan. En el siguiente entrenamiento, los investigadores los reinyectan a propósito en el sistema. Así obligan al modelo a enfrentarse a condiciones imperfectas.

Con el tiempo, la IA aprende a corregir el rumbo. Aunque arranque con una imagen deformada, logra volver a una secuencia clara y coherente para el ojo humano.

Wuyang Li, investigador posdoctoral, lo resume así: a diferencia de las personas, la IA no sabe recuperarse de sus errores. Por eso hay que enseñarle a hacerlo.

El método no exige enormes bases de datos ni potencia descomunal. Alahi lo compara con entrenar a un piloto en turbulencia y no solo en cielo despejado.

Integraron esta técnica en un sistema llamado Stable Video Infinity. Genera videos de varios minutos sin que la coherencia se derrumbe.

Impacto

El sistema es de código abierto en GitHub y lo presentarán en la International Conference on Learning Representations 2026 en abril.

La comunidad reaccionó fuerte. Un gran youtuber de IA lo difundió y superó 150 mil vistas. El repositorio acumuló más de 1.900 estrellas.

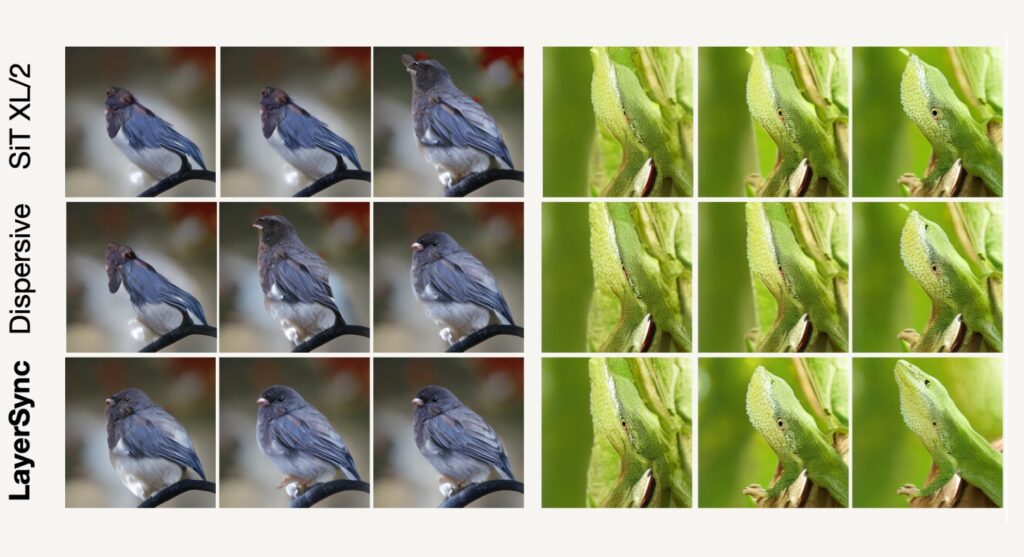

Además, el laboratorio aplicó la misma lógica en otro método llamado LayerSync, también presentado en ICLR. Aquí reciclan no solo errores visibles, sino la lógica interna del modelo.

LayerSync permite que las partes “expertas” del sistema guíen a las demás durante el entrenamiento. El modelo se corrige desde dentro y aprende más rápido.

El impacto va más allá del video. Este enfoque puede ayudar a crear sistemas autónomos más seguros y capaces de interactuar mejor con personas. Y eso sí cambia el juego. Los detalles del trabajo están disponibles en Arxiv.